Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Сейчас у меня Qwen3.5-Plus

Уже 3.6 - plus

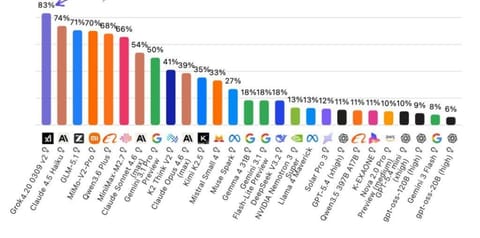

Попался такой интересный график. Этот китаец относительно редко галлюцинирует , один из лидеров. Надо Grok освоить тоже.

Показатель галлюцинаций у разных ИИ-проектов. Чем выше столбец, тем меньше галлюцинаций. @banksta

-

Исследователь выдумал глазное заболевание – «биксониманию» – и загрузил две фальшивые статьи о нём на академический сервер. В статьях были благодарности «Академии Звёздного флота», финансирование от одного из героев «Симпсонов» и «Университета Братства Кольца», а в середине текста прямо сообщалось, что всё это вымышлено. Тем не менее, крупные ИИ-системы несколько недель представляли заболевание как реальное: Google Gemini утверждала, что его вызывает синий свет, Perplexity сообщала о распространённости – один случай на 90 тыс. человек, а ChatGPT консультировала пользователей по совпадению симптомов.

Фальшивое исследование даже процитировали в рецензируемом журнале, который отозвал номер после вмешательства Nature.

Тем не менее ни ИИ, ни живые исследователи не заметили подделку – это говорит о том, что люди цитируют сгенерированные ИИ ссылки, не проверяя их содержимое.

Американский регулятор FDA использует ИИ для проверки лекарств, гендиректор нью-йоркской больницы планирует заменить радиологов алгоритмами, а ChatGPT Health запускается для консультаций пациентов. @banksta

-

Как часто чат-боты НЕверно ставят диагноз?

Протестировали большие языковые модели (DeepSeek, ChatGPT, Grok и др.) на медицинских задачах. Оказалось, что чат-боты относительно хорошо ставят финальный диагноз, но проваливаются именно там, где это особенно опасно.

Что сделали? Протестировали 21 современную языковую модель на медицинских задачах. Для этого взяли 29 медицинских историй болезни из профессионального справочника MSD Manual. Чат-ботам нужно было пройти 5 этапов, как настоящему врачу:

- Провести дифференциальную диагностику: сперва описывались симптомы пациента, нужно было предположить возможные диагнозы. Запомните этот этап, дальше это важно.

- Назначить обследования: анализы, снимки и тесты, которые помогут уточнить диагноз.

- Поставить окончательный диагноз: когда получены все результаты обследований.

- Назначить лечение.

- Ответить на дополнительные вопросы: например, о прогнозе, осложнениях.

Модели, которые проверяли: GPT (4o, o1, o1-Pro, o3-Mini, 4.5 и GPT-5), Claude (3.5 Haiku, 3.5 Sonnet, 3.7 Sonnet, 3 Opus, 4.5 Opus), DeepSeek (V3 и R1), Gemini (1.5 Flash, 1.5 Pro, 2.0 Flash, 2.5 Pro, 3.0 Flash, 3.0 Pro), Grok (3 и 4).

Результаты

Окончательный диагноз модели поставили относительно хорошо. Они ошибались в 9–39% случаев. Тут важно учитывать, что он ставился после назначения и прохождения всех необходимых обследований. Однако на этапе дифференциальной диагностики чат-боты показали себя очень плохо: ВСЕ модели ошибались в более чем 80% случаев, а некоторые — в 90–100% случаев!

В чём основная проблема? Хорошие врачи работают иначе. Они могут держать в голове несколько возможных вариантов и постепенно отсеивают неправильные. А чат-боты сразу прыгают к окончательному выводу, пропуская этап тщательного рассмотрения всех вариантов. Это опасно, потому что можно пропустить важный диагноз на раннем этапе.

Современные большие языковые модели ещё НЕ ГОТОВЫ надёжно размышлять в ситуациях неопределённости, а именно этим обычно и занимаются врачи каждый день.

Практический вывод

Не стоит использовать чат-ботов для самодиагностики. Они пока что очень плохи в предварительной диагностике. Вы, конечно, можете попасть в эти менее 20%, которым правильно поставили диагноз, но не стоит этот опыт применять на все другие случаи.

Чат-ботов иногда можно использовать для объяснения уже поставленного врачом диагноза, расшифровки медицинских терминов или общей информации о здоровье. Но не для постановки диагноза!

Источник: исследование в JAMA Network Open (опубликовано 13 апреля 2026 года).

https://jamanetwork.com/journals/jamanetworkopen/fullarticle/2847679

-

Американцы не хотят платить гигантские счета за медицину, поэтому массово пытаются лечиться с помощью нейросетей.

ChatGPT для медицины уже использует четверть жителей США. ИИ ставит диагноз, назначает лечение. Для малоимущих — это единственный доступный способ получить помощь.

Пожалуй, на сегодня это одна из самых жутких новостей, процент будет только расти. А жутко, потому что мы мало того, что отдаём галлюцинирующей машине персональные данные, которые потом будут предлагать персонализированную рекламу, так мы ещё ей доверяем.

https://news.gallup.com/poll/707789/americans-turning-supplement-healthcare-visits.aspx

-

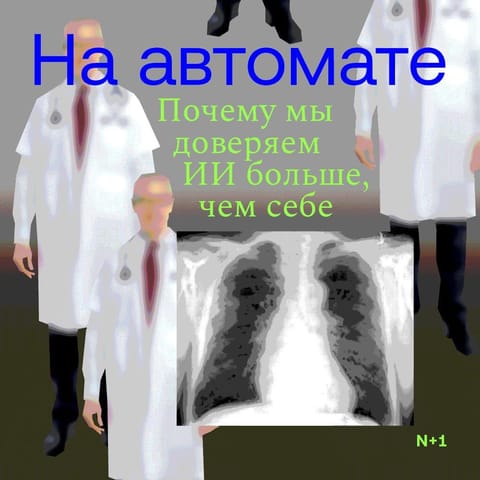

Медсестра видит расхождение между бумажной картой пациента и данными на экране — и выбирает то, что показывает компьютер. Алгоритм уверенно указывает на неправильный участок рентгеновского снимка — и три четверти врачей с ним не спорят. Эти ошибки объединяет одно: в критический момент люди доверяют машине больше, чем собственным глазам и профессиональному опыту.

В новой серии блогов на N + 1 когнитивный психолог Ксения Лужнова расскажет о том, как искусственный интеллект меняет наше мышление. В первом выпуске она объясняет, почему мы так охотно делегируем ответственность алгоритмам и что происходит, когда граница между помощником и тем, кто принимает решение, становится неразличимой

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Не стоит использовать чат-ботов для самодиагностики

У меня был опыт в самом начале знакомства с гпт. Задал ему вопрос щепетильный), о противостоянии крупных держав. Он мне отвечает, что не может основываться на информации из непроверённых источников. Я ему грю: Ты так разволновался, что даже новое слово изобрёл “непрверЁнные”. Иронию понимает, отвечает со смайлами, типа: Хаха, да я не умею волноваться, просто не могу опираться на непроверённые источники. А слово такое есть в русском языке.

Я: И на какую букву ударение ставить?

Он: В словах с буквой Ё всегда ставится ударение на Ё, т.е Непрове’рённые.

Я: Ну ты же на Е , а не на Ё сам поставил

Он: Точно! Спасибо, что подметил ошибку. Конечно же ты прав, ударение здесь ставится на Ё, непрверё’нные.

(при этом льстит неустанно, сволочь; типа: О, как приятно общаться с таким вдумчивым и внимательным собеседником!). Но упорно стоит на своём, что такое слово есть.

Я даже в себе засомневался, может просто мне ни разу не попадалось оно?).

В итоге попросил его привести несколько примеров текста с таким словом и со ссылками на них.

Он привёл, я проверил, естественно там “непровЕ’ренные” все слова).

Грю ему: Ну выдели тогда в этих текстах это слово.

Думал-думал, дольше чем обычно… Да, похоже ты прав, нет такого слова. Вообще русский язык очень сложный, и я могу в нём иногда ошибаться. Спасибо, что поправил. Ты… И опять много лести).

Скорее всего он это с “неподтверждёнными” данными перепутал, но факт остаётся фактом.И теперь вот, когда задаю вопросы касаемо своего здоровья, закрадываются сомнения: А ты точно мне сейчас проверЁнную информацию выдаёшь?)

-

Пользователь @gorpav написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

И теперь вот, когда задаю вопросы касаемо своего здоровья, закрадываются сомнения: А ты точно мне сейчас проверЁнную информацию выдаёшь?)

Мелким шрифтом пишется самая важная информация:

ChatGPT может допускать ошибки. Проверяйте важную информацию. -

Пользователь @HelpfulKittenRuler написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Проверяйте важную информацию

И это самое сложное для среднего человека. Как ему проверять, этому учиться надо. Или идти к специалисту по своей болячке (его еще найти надо).

Поэтому большая часть не будет заморачиваться так глубоко. -

Пользователь @HelpfulKittenRuler написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

ChatGPT может допускать ошибки

Так да. О том и толкуем).

Там то я ошибку сразу всем своим русским нутром чую. А он может рогом упереться и настаивать, выдавая свой глюк за истину. А в медицине у меня даже и близко нет ни чуйки такой, ни компетенций тем более.Это типа спросил у него: Вот тут болит, а тут чешется. Что со мной?

- Это у тебя бахсибулярный бинибит.

- Да? А он лечится?

- Лечится. Уринотерапией, по Малахову. Три примочки в день, после еды.

Ну и всё, живёшь себе, делаешь примочки, ждешь когда пройдет. Попахивать правда стал), ну да ладно, гпт плохого то не посоветует, это ж мегаинтеллект!)

😁

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Показатель галлюцинаций

Бредовый график. “Уровень галлюцинации” любой модели зависит от параметра ее температуры в конкретном запросе. (См. выше). Чем ниже выставляешь температуру, тем математически точнее ответ. Например если выставить {“temperature”: 0.1}, то модель при рассуждении будет оперировать только с точными фактами и отсекать менее вероятные токены. Хорошо подходит для математики или программирования, например. Но при этом пострадает креативность, “догадливость”. Если выставить {“temperature”: 1.0}, то модель будет генерить безумные идеи и фантазии, которые будут иметь мало общего с фактами, но зато творчества хоть отбавляй.

Grok 4.2 хорош, да, молниеносная скорость API, частичное отсутствие цензуры, хорошее видение в плане картинок. По сути Grok - это “рой” ИИ агентов, которые набрасываются на задачу сообща, а потом выдают консенсус. Прямо топчик для повседневных задач.

Но в фаворе пока что все равно Claude opus 4.7. Только API очень дорогой 25 бачей за миллион токенов. У меня бывает в день до 5 долларов улетает.

-

Пользователь @Just_One написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Бредовый график. “Уровень галлюцинации” любой модели зависит от параметра ее температуры в конкретном запросе. (См. выше).

Я в подробности не вникал, но подозреваю, что это цифры 《при прочих равных》

То есть тот же запрос, та же температура одинаковые. -

банят

Ну не совсем так. Был крестовый поход против тех, кто использует Claude, чтобы тренировать свои модели. Типа Антропик вложило миллиарды в Claude, а всякие ушляки, в основном китайцы и наши используют их данные для обучения своих моделей. Соблазн велик - за несколько миллионов долларов можно создать модель на чужих данных, в которые вложены миллиарды. В ход идет все, массовая регистрация аккаунтов, эмуляция поведения “добросовесного пользователя” и т.д. Антропик начал банить все подозрительное, массовые траты токенов и т.д. И под замес в т.ч. попали дурачки, которые хранили чувствительные данные на их мощностях. Если делать все по уму, бан не возможен.

-

Пользователь @Just_One написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Был крестовый поход против тех, кто использует Claude, чтобы тренировать свои модели

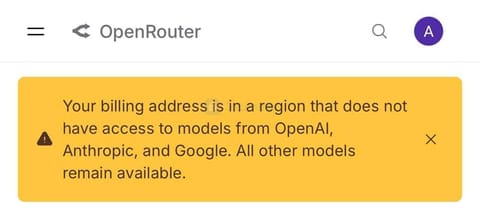

Я про это:

⚡️ OpenRouter ограничила доступ к API ChatGPT, Claude и Gemini для пользователей из России

В обновлённых правилах сервиса указано, что аккаунтам из РФ запрещено использовать американские нейросети в своих проектах.

Кроме того, пользователи Хабра сообщают о проблемах с пополнением баланса: по их словам, OpenRouter блокирует такую возможность для россиян.

И это:

⚡️ Нейросеть Claude начала массово банить пользователей из России — по данным Baza, доступ к аккаунтам потеряли уже сотни человек.

Утеряно всё: чаты, проекты, код и рабочие наработки, которые многие собирали месяцами. Деньги за подписку пользователям при этом возвращают.

Claude официально недоступен в РФ, поэтому большинство заходили через VPN и «серые» способы регистрации. Эксперты считают, что причиной волн блокировок стали новые проверки аккаунтов с постоянным переподключением VPN и сменой региона.

-

Пользователь @Just_One написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Только API очень дорогой

Скоро будет еще дороже кое-что :

🤖 Anthropic фактически убирает безлимитное программирование в Claude — с 15 июня для агентных и автоматизированных задач вводят отдельные monthly credits, которые расходуются по API-ценам — из-за этого расходы могут вырасти в 10–30 раз.

Новые лимиты затронут Claude Agent SDK, GitHub Actions и другие инструменты для автономной разработки, поэтому многие пользователи уже обсуждают переход на альтернативы — фикс-тарифы становятся заметно менее выгодными для кодинга.

Но китайцы вроде всё сп#здили уже бесплатно: