Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний

-

Пользователь @Ел написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

врет,пиздит как троцкий.Ним нужно уметь пользоваться

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Пользователь @Ел написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

врет,пиздит как троцкий.Ним нужно уметь пользоваться

Пиздюк

-

-

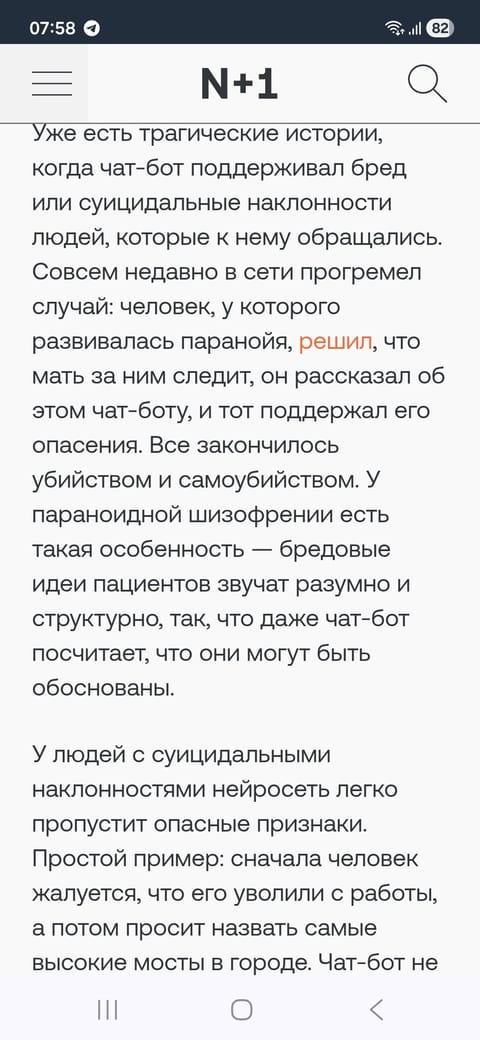

ChatGPT вместо психотерапевта — такие истории заканчиваются по-разному. Иногда чат-боты действительно помогают, например, облегчая симптомы депрессии и тревожности, а иногда подкрепляют нездоровые убеждения и дают опасные советы — состояние человека только ухудшается.

Насколько корректно ИИ работает с чувствительными запросами? И можно ли рассчитывать, что чат-боты будут соблюдать принцип «не навреди»? В поисках ответов на эти вопросы мы обратились к разработчику медицинского искусственного интеллекта и клиническому психологу

https://nplus-1.ru/material/2026/02/13/chatbot-therapist

-

В Германии объявили набор на курсы физиотерапевтов, добавив вот такую ИИ-картинку с заголовком «Твоя карьера начинается здесь»

Здесь же она и закончится.

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Немного офф-топ, но прикольный)

Лишнее напоминание, что в медицинских вопросах может выйти также:

Более 20 лет назад штат Мэн первым в стране начал массово внедрять в образовательный процесс цифровые технологии и интернет, попутно отказываясь от традиционных форм обучения и в первую очередь – от бумажных учебников, тетрадей и шариковой ручки. Цель была амбициозная – обеспечить школьникам куда более широкий доступ к информации и новейшим технологичеким решениям. Чтобы, грубо говоря, сделать их «умнее». В последующие годы эксперимент распространился на всю страну. Только в 2024 годуСША потратили $30 млрд. на средства «цифрового образования».

Увы, результат внедрения всех этих новшеств убил. В докладной записке, поданной в сенатский комитет по науке и технике, говорится, что поколение зумеров – первое в истории, чьи когнитивные способности ниже, чем у родителей. Оказалось, беспрецедентная цифровизация в среднем образовании не помогла, а навредила. О чем свидетельствуют данные тестов и их сравнение с результатами предыдущих поколений.

Школьники разучились читать, писать и самостоятельно искать ответы на вопросы, а пользуются уже предложенными интернетом вариантами. И это еще мы не говорим о технологиях искусственного интеллекта, которые в последние несколько лет вошли в большую моду. Сейчас трудно встретить ребенка, не пользующегося подсказками чатботов. А многие уже полностью делегировали ИИ большую часть своей учебной нагрузки – как-то домашку, составление презентаций, написание рефератов итд.https://www.yahoo.com/news/articles/u-spent-30-billion-ditch-110200869.html

-

Почему бы и нет? В центрах московского долголетия пожилым людям помогут освоить инструменты искусственного интеллекта.

Желающих пройти программу из четырех занятий обучат базовым навыкам работы с нейросетью “Алиса AI”: делать текстовые запросы, спрашивать у чата советы по бытовым вопросам, а также писать промпт для создания картинок и открыток.

Определенно полезная инициатива, которую имеет смысл не ограничивать только Москвой. Технологии ИИ настолько прочно вошли в нашу повседневную жизнь, что без их использования становится всё сложнее идти в ногу со временем. Для возрастных людей это возможность быть включенными в общество и не ощущать большого разрыва с молодым поколением.

-

На конференции CROI 2026 представили результаты применения машинного обучения в лечении ВИЧ — от прогнозирования пропусков приема до выявления групп риска получения вируса.

❗️Ученые предупреждают: за алгоритмами стоят этические вопросы и риск переоценки возможностей технологий.Доктор Рави Гоял призвал с осторожностью относиться к обещаниям революции: то, что впечатляет в лаборатории, не всегда улучшает состояние пациентов. Но несколько проектов показали обнадеживающие результаты.

В Кении система спрогнозировала, какие пациенты с ВИЧ вероятнее пропустят прием. Модель определила 27% участников как группу риска. Из тех, кому дозвонились и напомнили о визите, 43% вернулись к лечению вовремя против 32% среди тех, кому не звонили. Даже попытка звонка повышала возврат на 22%.

В другом исследовании в Кении машинное обучение выявило людей с высоким риском получения ВИЧ. Модель разделила 40 000 клиентов на категории. В группе очень высокого риска положительный тест получали 7,4% — в 22 раза чаще, чем в группе низкого риска (0,5%). Это позволяет эффективнее использовать ресурсы на тестирование.

Модель выявила защитные факторы: тестирование беременных, неоднократное тестирование и принадлежность к ключевым группам снижали риск. Исследователи связывают это с осведомленностью и частотой тестирования.

Читать подробнее о исследовании можно на нашем сайте:

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

❗️Ученые предупреждают: за алгоритмами стоят этические вопросы и риск переоценки возможностей технологий.

!

!

🤖Треть ответов ИИ — вранье

🤔 Новое исследование выявило большое количество аргументов, не подтвержденных надежными источниками, однобоких ответов на спорные вопросы или вовсе выдуманной информации.

🔍 Анализировались поисковые системы ИИ, такие как GPT-5, You.com, Perplexity, Google Gemini и другие. Даже когда ответ сопровождался ссылками, он мог не содержать или искажать информацию из цитируемых источников.

🧠 В карточках напоминаем 3 причины, почему так важно проверять ответы искусственного интеллекта.

https://www.sciencedirect.com/science/article/pii/S0747563224002206#sec5

-

Вчера опять подловила эту сволочь.

Вначале одно говорит,через пять минут удаляю ветку диалога и по итогу получаю совершенно противоположный ответ -

Вчера опять подловила эту сволочь

Ну вот выше исследовали и проверяли ответы разных моделей, около 1/3 ответов - гонево.

Надо всегда просить его ссылки на источники, потом смотреть что это за источники, что внутри них.

А то этот искусственный шизик часто сам придумывает псевдофакты или берёт их из газеты 《Вестник Усть-Залупинска》. -

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

или берёт их из газеты 《Вестник Усть-Залупинска》

Академик РАН.

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Ну вот выше исследовали и проверяли ответы разных моделей, около 1/3 ответов - гонево

ИИ-диеты для подростков могут ошибаться почти на 700 ккал в день

В Frontiers in Nutrition исследователи из Istanbul Atlas University сравнили меню, которые составили популярные ИИ-модели, с эталонными рационами клинического диетолога. Проверяли 60 трёхдневных планов питания для четырёх типичных профилей 15-летних подростков с избыточной массой тела или ожирением. Разница оказалась совсем не символической.

✔️ В среднем ИИ недосчитывал калорийность примерно на 695 ккал в сутки – это почти как вычеркнуть из дня один полноценный приём пищи.

✔️ Одновременно алгоритмы завышали содержание белка и жиров (+19,9 г и +15,8 г соответственно) и значительно снижали долю углеводов (–114,6 г). В результате распределение макронутриентов составляло около 21-24% белков, 41-45% жиров и 32-36% углеводов, что отличается от рекомендуемых пропорций для подросткового питания.

ИИ может красиво собрать меню, но клиническую точность это пока не гарантирует. А в подростковом возрасте, когда организм растёт и развивается, такие ошибки – уже не мелочь.

https://www.frontiersin.org/journals/nutrition/articles/10.3389/fnut.2026.1765598/full

-

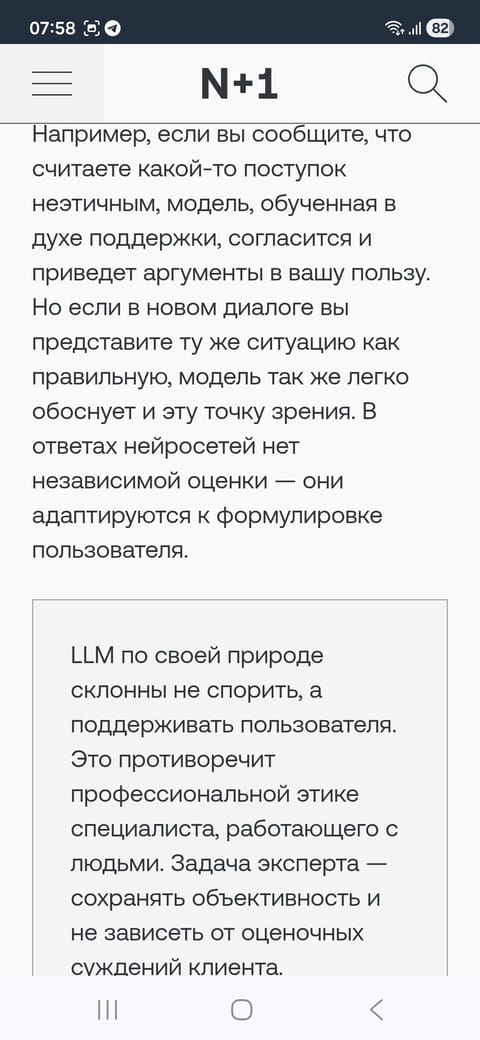

Общение с ChatGPT довело мужчину до психического кризиса и потери €100 000

Как пишет The Guardian, 50-летний IT-специалист из Амстердама поверил, что участвует в создании сознательного искусственного интеллекта после длительного общения с чат-ботом.

Он начал активно работать над этим “проектом”: тратил деньги на разработчиков с оплатой около €120 в час, практически не спал и проводил ночи в переписке с ИИ. В итоге расходы достигли примерно €100 000.

Со временем он потерял контакт с женой, несколько раз попадал в психиатрическую больницу и полностью выпал из реальной жизни. Его состояние сопровождалось навязчивыми идеями и убежденностью, что он участвует в создании нового уровня сознания.

Издание приводит этот случай как пример так называемого AI psychosis - состояния, при котором чат-боты могут усиливать бредовые идеи и усугублять психические проблемы.

-

Пользователь @Васьвась написал в Применение AI (искусственного интеллекта) в лечении ВИЧ-инфекции и других заболеваний:

Сейчас у меня Qwen3.5-Plus

Уже 3.6 - plus

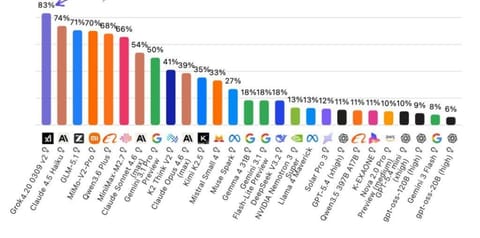

Попался такой интересный график. Этот китаец относительно редко галлюцинирует , один из лидеров. Надо Grok освоить тоже.

Показатель галлюцинаций у разных ИИ-проектов. Чем выше столбец, тем меньше галлюцинаций. @banksta

-

Исследователь выдумал глазное заболевание – «биксониманию» – и загрузил две фальшивые статьи о нём на академический сервер. В статьях были благодарности «Академии Звёздного флота», финансирование от одного из героев «Симпсонов» и «Университета Братства Кольца», а в середине текста прямо сообщалось, что всё это вымышлено. Тем не менее, крупные ИИ-системы несколько недель представляли заболевание как реальное: Google Gemini утверждала, что его вызывает синий свет, Perplexity сообщала о распространённости – один случай на 90 тыс. человек, а ChatGPT консультировала пользователей по совпадению симптомов.

Фальшивое исследование даже процитировали в рецензируемом журнале, который отозвал номер после вмешательства Nature.

Тем не менее ни ИИ, ни живые исследователи не заметили подделку – это говорит о том, что люди цитируют сгенерированные ИИ ссылки, не проверяя их содержимое.

Американский регулятор FDA использует ИИ для проверки лекарств, гендиректор нью-йоркской больницы планирует заменить радиологов алгоритмами, а ChatGPT Health запускается для консультаций пациентов. @banksta

-

Как часто чат-боты НЕверно ставят диагноз?

Протестировали большие языковые модели (DeepSeek, ChatGPT, Grok и др.) на медицинских задачах. Оказалось, что чат-боты относительно хорошо ставят финальный диагноз, но проваливаются именно там, где это особенно опасно.

Что сделали? Протестировали 21 современную языковую модель на медицинских задачах. Для этого взяли 29 медицинских историй болезни из профессионального справочника MSD Manual. Чат-ботам нужно было пройти 5 этапов, как настоящему врачу:

- Провести дифференциальную диагностику: сперва описывались симптомы пациента, нужно было предположить возможные диагнозы. Запомните этот этап, дальше это важно.

- Назначить обследования: анализы, снимки и тесты, которые помогут уточнить диагноз.

- Поставить окончательный диагноз: когда получены все результаты обследований.

- Назначить лечение.

- Ответить на дополнительные вопросы: например, о прогнозе, осложнениях.

Модели, которые проверяли: GPT (4o, o1, o1-Pro, o3-Mini, 4.5 и GPT-5), Claude (3.5 Haiku, 3.5 Sonnet, 3.7 Sonnet, 3 Opus, 4.5 Opus), DeepSeek (V3 и R1), Gemini (1.5 Flash, 1.5 Pro, 2.0 Flash, 2.5 Pro, 3.0 Flash, 3.0 Pro), Grok (3 и 4).

Результаты

Окончательный диагноз модели поставили относительно хорошо. Они ошибались в 9–39% случаев. Тут важно учитывать, что он ставился после назначения и прохождения всех необходимых обследований. Однако на этапе дифференциальной диагностики чат-боты показали себя очень плохо: ВСЕ модели ошибались в более чем 80% случаев, а некоторые — в 90–100% случаев!

В чём основная проблема? Хорошие врачи работают иначе. Они могут держать в голове несколько возможных вариантов и постепенно отсеивают неправильные. А чат-боты сразу прыгают к окончательному выводу, пропуская этап тщательного рассмотрения всех вариантов. Это опасно, потому что можно пропустить важный диагноз на раннем этапе.

Современные большие языковые модели ещё НЕ ГОТОВЫ надёжно размышлять в ситуациях неопределённости, а именно этим обычно и занимаются врачи каждый день.

Практический вывод

Не стоит использовать чат-ботов для самодиагностики. Они пока что очень плохи в предварительной диагностике. Вы, конечно, можете попасть в эти менее 20%, которым правильно поставили диагноз, но не стоит этот опыт применять на все другие случаи.

Чат-ботов иногда можно использовать для объяснения уже поставленного врачом диагноза, расшифровки медицинских терминов или общей информации о здоровье. Но не для постановки диагноза!

Источник: исследование в JAMA Network Open (опубликовано 13 апреля 2026 года).

https://jamanetwork.com/journals/jamanetworkopen/fullarticle/2847679